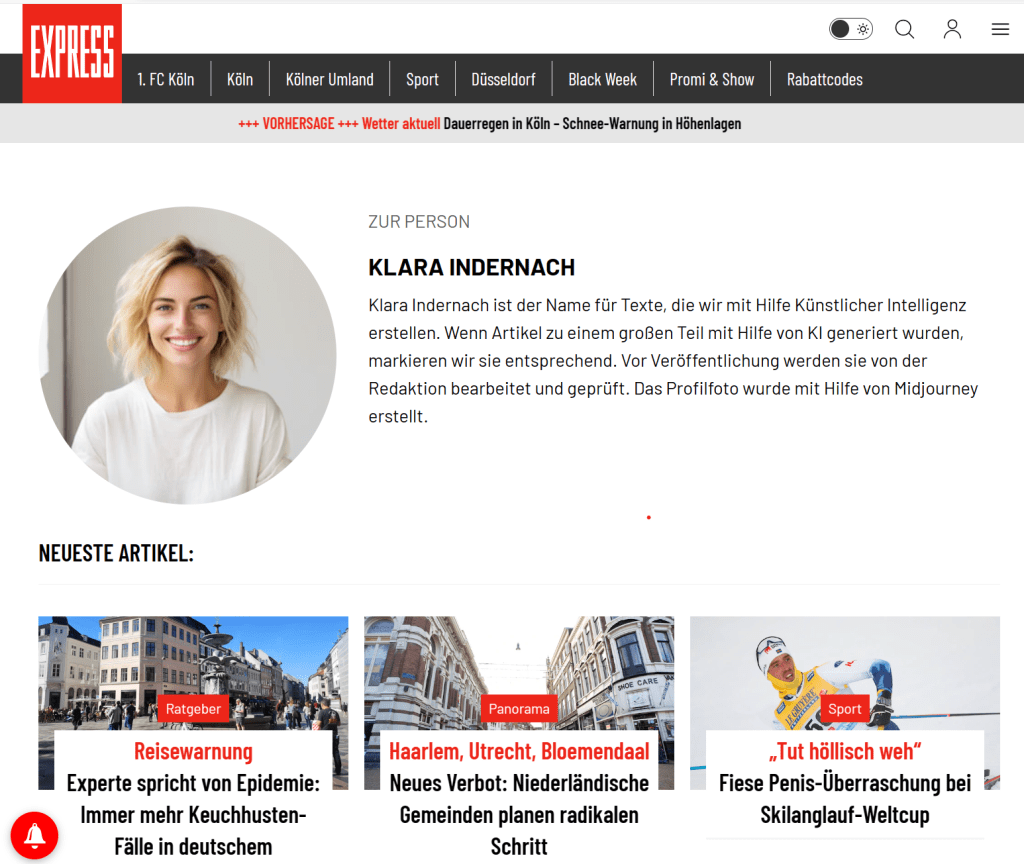

Klara ist jung, blond, hübsch. Sie ist überaus fleißig wie auch sehr vielseitig talentiert. Sie schreibt seit diesem Sommer für die Kölner Boulevardzeitung „express.de“ über eine große Spannweite von Themen, wie etwa Promi-News, Lebensmittelpreise, Chrome Updates oder Todesfälle. Wie schafft sie das alles bloß? Ein Klick auf ihren Namen klärt auf: Klara Indernach ist eine künstliche Intelligenz, ihr Kürzel: KI.

Der Kölner Express ist eine der größten Boulevardzeitungen Deutschlands und weist eine beachtliche Breite an Themen auf. Gar nicht so einfach für Journalisten, hier immer up-to-date zu bleiben. Eine künstliche Intelligenz wie Klara tut sich hier schon leichter. Und deckt auch Themen ab, die manchen Journalist*innen vielleicht ohnehin zu mühselig oder zu langweilig sind.

Das wird auch auf der Seite der angeblichen Autorin deutlich, von der weit über 200 Meldungen querbeet vom Wetter bis zum Sport stammen. Über den Texten wird mit dem Zusatz “ (KI)“ als Initialen der angeblichen Autorin allerhöchstens versteckt darauf hingewiesen, dass es sich um einen KI-generierten Text handelt. Bei Menschen werden die Initialien kleingeschrieben. Unter den Texten steht, dass diese “mit Hilfe Künstlicher Intelligenz erstellt, redaktionell bearbeitet und geprüft” wurden. Aber ist das wirklich genug?

Wobei der Express nicht die erste Zeitung ist, die KI-Texte veröffentlicht. Schon im Frühjahr hat der Burda-Verlag eine Extraausgabe des Rezeptemagazins Lisa Kochen & Backen komplett mit Inhalten von Text- und Bildgeneratoren befüllt, ohne das kenntlich zu machen. Auch Nachrichtenagenturen wie Reuters oder Associated Press nutzen KI, um routinemäßige Berichte über Finanzen, Sport oder Wetter zu erstellen. Die Vorteile von KI für Verlage und Medienhäuser liegen auf der Hand: Weniger Personalkosten, mehr Effizienz, schnelle Reaktion auf aktuelle Ereignisse. KI kann auch dabei helfen, große Datenmengen auszuwerten, personalisierte Inhalte anzubieten oder Falschinformationen zu erkennen.

Doch KI im Journalismus birgt auch viele Risiken und Herausforderungen. Zum einen ist die Qualität der KI-Texte oft fragwürdig. KI kann zwar Texte verarbeiten, aber nicht bewerten, was vertrauenswürdige Quellen sind. KI kann auch keine eigenen Recherchen anstellen, kritische Fragen stellen oder komplexe Zusammenhänge erklären. KI kann zudem falsche oder irreführende Informationen in die Texte einbauen, die schwer zu erkennen sind. Zum anderen ist die Transparenz und Verantwortung bei KI-Texten oft unklar. Wer haftet, wenn ein KI-Text Fehler enthält oder jemanden verletzt? Wie können Leser*innen erkennen, ob ein Text von einer KI oder einem Menschen geschrieben wurde? Wie können sie die Glaubwürdigkeit und Unabhängigkeit eines KI-Textes überprüfen? Wie können sie ihre Meinung oder ihr Feedback zu einem KI-Text äußern?

Ein besonders problematischer Aspekt ist mE die Vermenschlichung von KI im Journalismus. Der Express hat seiner KI nicht nur einen Namen, sondern auch ein Gesicht gegeben. Das Profilbild von Klara Indernach ist ein von einer KI generiertes Foto einer idealisierten jungen, blonden, „pretty-privileged“ Person, das von der Website Midjourney stammt. Damit wird die KI als eine Person und Autorin dargestellt, die eine eigene Identität, Persönlichkeit und Meinung hat. Das ist nicht nur irreführend, sondern auch ethisch bedenklich. Denn damit wird die KI als eine Konkurrenz für menschliche Journalistinnen und Journalisten dargestellt, die nicht müde wird, nicht krank ist, keinen Urlaub benötigt, keine Rechte oder Ansprüche hat. Der Nachname „Indernach“ erinnert wohl nicht zufällig daran, dass diese Mitarbeiterin auch „In der Nacht“ arbeitet und dafür keine Überstundenzuschläge abrechnet. Und damit werden wohl auch erst recht die Ängste von vielen Menschen vor dem Arbeitsplatzverlust durch KI geschürt.

Dabei sollte KI nicht als Ersatz, sondern als ein Werkzeug für den Journalismus angesehen werden. KI kann Journalist*innen unterstützen, aber nicht ersetzen. KI kann Routineaufgaben übernehmen, aber nicht kreative oder analytische Aufgaben. KI kann Daten verarbeiten, aber nicht interpretieren oder kontextualisieren. KI kann Texte generieren, aber nicht kommunizieren oder interagieren. KI kann Fakten liefern, aber nicht Werte oder Normen. KI kann Informationen verbreiten, aber nicht informieren oder aufklären.

Um die Chancen der Künstlichen Intelligenz für einen ausgewogenen und demokratieförderlichen Journalismus zu nutzen, raten etwa die Expertinnen und Experten der Plattform Lernende Systeme zu einem verantwortungsvollen Umgang mit KI-basierten Medieninhalten und KI-Werkzeugen sowohl in den Redaktionen als auch beim Medienpublikum. Dazu gehören unter anderem:

- Eine klare Kennzeichnung von KI-Texten, die den Leserinnen und Lesern ermöglicht, die Herkunft, den Zweck und die Qualität der Texte zu verstehen.

- Eine transparente Dokumentation von KI-Systemen, die die Datenquellen, die Algorithmen, die Ziele und die Grenzen der KI offenlegt.

- Eine ethische Bewertung von KI-Systemen, die die potenziellen Auswirkungen der KI auf die Gesellschaft, die Demokratie, die Meinungsvielfalt und die Menschenrechte berücksichtigt.

- Eine kontinuierliche Überwachung und Kontrolle von KI-Systemen, die Fehler, Manipulationen oder Diskriminierungen erkennt und korrigiert.

- Eine partizipative Gestaltung von KI-Systemen, die die Beteiligung und Mitbestimmung von Journalistinnen und Journalisten, Medienunternehmen, Nutzerinnen und Nutzern, Regulierungsbehörden und anderen Stakeholdern fördert.

KI im Journalismus hat viele Potentiale, birgt aber auch echte Gefahren. Wir sind nun gefordert, wie wir damit umgehen wollen, welche Chancen wir nutzen und welche Abgründe wir besser absichern wollen. Wenn wir das richtig machen, kann KI eine echte Bereicherung für den Journalismus werden. Dazu zählt aber auch, dass wir KI nicht als eine künstliche Person, sondern als eine assistierende Technologie verstehen. Dass wir KI nicht blind vertrauen, sondern kritisch hinterfragen. Dass wir KI nicht nur passiv konsumieren, sondern aktiv gestalten. Denn letztlich ist KI nur so gut oder so schädlich, wie wir sie machen.

Und wann schickt man Klara dann auch mal zum Frisör?